A inteligência artificial (IA) tem um imenso potencial para otimizar processos internos dentro das empresas. No entanto, ele também vem com preocupações legítimas em relação ao uso não autorizado, incluindo riscos de perda de dados e consequências legais. Neste artigo, exploraremos os riscos associados à implementação de IA e discutiremos medidas para minimizar danos. Além disso, examinaremos as iniciativas regulatórias dos países e as estruturas éticas adotadas pelas empresas para regular a IA.

Riscos de segurança

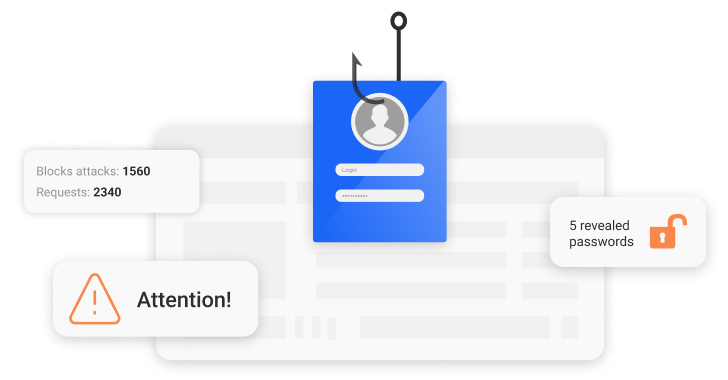

Ataques de phishing de IA

Os cibercriminosos podem aproveitar a IA de várias maneiras para aprimorar seus ataques de phishing e aumentar suas chances de sucesso. Aqui estão algumas maneiras pelas quais a IA pode ser explorada para phishing:

- – Campanhas de phishing automatizadas: Ferramentas alimentadas por IA podem automatizar a criação e disseminação de e-mails de phishing em larga escala. Essas ferramentas podem gerar conteúdo de e-mail convincente, criar mensagens personalizadas e imitar o estilo de escrita de um indivíduo específico, fazendo com que as tentativas de phishing pareçam mais legítimas.

- – Spear Phishing com Engenharia Social: A IA pode analisar grandes quantidades de dados disponíveis publicamente de mídias sociais, redes profissionais ou outras fontes para coletar informações sobre alvos potenciais. Essas informações podem ser usadas para personalizar e-mails de phishing, tornando-os altamente personalizados e difíceis de distinguir de comunicações genuínas.

- Ataques de Processamento de Linguagem Natural (NLP): Os algoritmos de PNL alimentados por IA podem analisar e entender texto, permitindo que os cibercriminosos criem e-mails de phishing que são contextualmente relevantes e mais difíceis de detectar pelos filtros de e-mail tradicionais. Esses ataques sofisticados podem ignorar as medidas de segurança projetadas para identificar tentativas de phishing.

Para mitigar os riscos associados a ataques de phishing aprimorados por IA, as organizações devem adotar medidas de segurança robustas. Isso inclui treinamento de funcionários para reconhecer tentativas de phishing, implementação de autenticação multifator e aproveitamento de soluções baseadas em IA para detectar e se defender contra a evolução das técnicas de phishing. Empregar a filtragem DNS como uma primeira camada de proteção pode aumentar ainda mais a segurança.

Regulação e riscos legais

Com o rápido desenvolvimento da IA, as leis e regulamentações relacionadas à tecnologia ainda estão evoluindo. Os riscos regulatórios e legais associados à IA referem-se às potenciais responsabilidades e consequências legais que as empresas podem enfrentar ao implementar a tecnologia de IA.

– À medida que a IA se torna mais prevalente, governos e reguladores estão começando a criar leis e regulamentos que regem o uso da tecnologia. O não cumprimento dessas leis e regulamentos pode resultar em penalidades legais e financeiras.

– Responsabilidade por danos causados por sistemas de IA: As empresas podem ser responsabilizadas por danos causados por seus sistemas de IA. Por exemplo, se um sistema de IA cometer um erro que resulte em perda financeira ou dano a um indivíduo, a empresa pode ser responsabilizada.

– Disputas de propriedade intelectual: As empresas também podem enfrentar disputas legais relacionadas à propriedade intelectual ao desenvolver e usar sistemas de IA. Por exemplo, podem surgir disputas sobre a propriedade dos dados usados para treinar sistemas de IA ou sobre a propriedade do próprio sistema de IA.

Países e empresas que restringem a IA

Medidas Regulatórias:

Vários países estão implementando ou propondo regulamentações para lidar com os riscos de IA, com o objetivo de proteger a privacidade, garantir a transparência algorítmica e definir diretrizes éticas.

Exemplos: O Regulamento Geral de Proteção de Dados (GDPR) da União Europeia estabelece princípios para o uso responsável de dados dos sistemas de IA, enquanto a Lei de IA proposta busca fornecer regras abrangentes para aplicativos de IA.

A China lançou regulamentos específicos de IA, com foco em segurança de dados e responsabilidade algorítmica, enquanto os Estados Unidos estão envolvidos em discussões contínuas sobre governança de IA.

Iniciativas Corporativas:

Muitas empresas estão tomando medidas proativas para governar o uso de IA de forma responsável e ética, muitas vezes por meio de restrições autoimpostas e estruturas éticas.

Exemplos: os Princípios de IA do Google enfatizam a prevenção de preconceitos, transparência e responsabilidade. A Microsoft estabeleceu o Comitê de IA e Ética em Engenharia e Pesquisa (AETHER) para orientar o desenvolvimento responsável de IA. A IBM desenvolveu o kit de ferramentas AI Fairness 360 para abordar o preconceito e a justiça em modelos de IA.

Conclusão.

É altamente recomendável implementar sistemas de proteção abrangentes e consultar o departamento jurídico sobre os riscos associados ao utilizar IA. Se os riscos do uso de IA superarem os benefícios e as diretrizes de conformidade da sua empresa desaconselharem a utilização de determinados serviços de IA em seu fluxo de trabalho, você poderá bloqueá-los usando um serviço de filtragem de DNS da SafeDNS. Ao fazer isso, você pode mitigar os riscos de perda de dados, manter a conformidade legal e aderir aos requisitos internos da empresa.

Se você precisa de ajuda para avaliar e/ou elevar o seu nível de segurança, entre em contato com a 4Security, teremos prazer em direcionar um especialista para lhe atender.